El panorama de la IA ha cambiado drásticamente. En enero de 2025, DeepSeek R1 irrumpió en escena — un modelo de razonamiento de pesos abiertos que igualaba el rendimiento de clase GPT-4 mientras era completamente auto-alojable. Envió ondas de choque a través de la industria, eliminando brevemente casi 1 billón de dólares de la capitalización bursátil de Nvidia y obligando a cada equipo tecnológico a hacerse una pregunta simple: ¿por qué seguimos pagando por IA en la nube?

Un año después, la respuesta es aún más clara. DeepSeek R1 y sus variantes destiladas funcionan perfectamente en hardware convencional a través de Ollama. ChatGPT sigue siendo un producto cloud pulido — pero a un costo recurrente, con tus datos fluyendo a través de los servidores de OpenAI.

En esta comparación exhaustiva, analizaremos costo, privacidad, rendimiento y casos de uso para ayudarte a decidir qué camino es el correcto para tu equipo en 2026.

TL;DR — La comparación rápida

| Característica | DeepSeek R1 (Auto-alojado) | ChatGPT (Cloud de OpenAI) |

|---|---|---|

| Alojamiento | Tu hardware / VPS | Servidores de OpenAI |

| Modelo de costos | Hardware único + electricidad | $20–200/mes por usuario (suscripción) o API de pago por token |

| Privacidad de datos | 100% local — nada sale de tu red | Datos procesados en servidores de OpenAI |

| Acceso al modelo | Pesos abiertos (licencia MIT) | Propietario, código cerrado |

| Uso sin conexión | ✅ Funcionalidad completa sin conexión | ❌ Requiere internet |

| Personalización | Fine-tuning, cuantización, modificación libre | Limitado a prompts del sistema y GPTs |

| Calidad de razonamiento | Comparable a GPT-4o en benchmarks de matemáticas y código | Estado del arte con GPT-4o / o1 |

| Facilidad de instalación | ~10 minutos con Ollama | Regístrate y listo |

| Tamaños de modelo | 1.5B a 671B parámetros | N/A (solo cloud) |

| Límites de tasa | Ninguno — limitado solo por tu hardware | Límites de tasa API por nivel |

Por qué DeepSeek R1 lo cambió todo

La revolución de los pesos abiertos

DeepSeek R1 no fue solo otro modelo de código abierto. Fue la prueba de que un laboratorio de IA chino podía producir capacidades de razonamiento que rivalizaban con lo mejor de OpenAI — y luego liberar los pesos gratuitamente. La familia de modelos va desde una versión destilada diminuta de 1.5B (funciona en una Raspberry Pi) hasta el completo behemoth de 671B parámetros Mixture-of-Experts.

Resultados clave de benchmarks que llamaron la atención:

- AIME 2024 (Matemáticas): DeepSeek R1 obtuvo 79.8%, comparable al o1-mini de OpenAI

- Codeforces (Programación competitiva): Puntuación Elo de 2,029 — rivalizando con los mejores competidores humanos

- MATH-500: 97.3% de precisión, superando a GPT-4o

- GPQA Diamond (Ciencia nivel posgrado): 71.5%, competitivo con o1-preview

El mensaje era inequívoco: ya no necesitas una factura API de $200/mes para acceder a razonamiento de nivel frontera.

Por qué importa ahora

En 2026, el ecosistema DeepSeek ha madurado significativamente:

- Ollama proporciona despliegue con un solo comando para todas las variantes de DeepSeek R1

- Modelos cuantizados (Q4_K_M, Q8) permiten que el destilado 70B funcione sin problemas en un MacBook Pro con 64GB de RAM

- Open WebUI te da una interfaz tipo ChatGPT sobre tu modelo local

- Existen fine-tunes de la comunidad para cada dominio, desde legal hasta médico y revisión de código

La infraestructura está lista para producción. La pregunta no es puedes auto-alojar — es ¿por qué no lo harías?

Comparación de costos: los números no mienten

Precios de ChatGPT en 2026

La estructura de precios de OpenAI ha evolucionado, pero el modelo central sigue igual: pagas por usuario, por mes, para siempre.

| Plan | Precio | Lo que obtienes |

|---|---|---|

| Gratuito | $0 | Acceso GPT-4o limitado, tasa limitada |

| Plus | $20/mes | Más GPT-4o, acceso a o1, DALL-E, navegación |

| Pro | $200/mes | Acceso ilimitado a todos los modelos, modo o1 Pro |

| Team | $25–30/usuario/mes | Funciones de workspace, controles de administración |

| Enterprise | Personalizado | SSO, cumplimiento, soporte dedicado |

Precios de API (pago por token):

- GPT-4o: ~$2.50/1M tokens de entrada, ~$10/1M tokens de salida

- o1: ~$15/1M tokens de entrada, ~$60/1M tokens de salida

Para un equipo de 10 desarrolladores usando ChatGPT Plus, eso es $2,400/año como mínimo. El uso intensivo de la API puede fácilmente elevar los costos a $10,000–50,000/año.

Costos de DeepSeek R1 auto-alojado

La belleza del auto-alojamiento: los costos son fijos y predecibles.

| Configuración | Costo de hardware | Costo mensual | Nivel de rendimiento |

|---|---|---|---|

| MacBook Pro M4 Max (128GB) | ~$4,000 (¿ya lo tienes?) | ~$5 electricidad | Ejecuta el destilado 70B cómodamente |

| Desktop con RTX 4090 (24GB) | ~$2,000 GPU | ~$10 electricidad | Ejecuta el destilado 32B a gran velocidad |

| VPS (Hetzner, 8 vCPU, 32GB) | — | ~$30/mes | Ejecuta el destilado 14B para un equipo pequeño |

| Servidor dual RTX 3090 | ~$3,000 total | ~$20 electricidad | Ejecuta el destilado 70B, sirve 5–10 usuarios |

| GPU Cloud (RunPod/Vast.ai) | — | ~$50–150/mes | Modelo completo 671B posible |

Comparación de costos anuales — ChatGPT Plus vs DeepSeek R1 auto-alojado

Análisis de punto de equilibrio para un equipo de 10 personas:

- ChatGPT Plus para 10 usuarios: $200/mes = $2,400/año

- DeepSeek R1 auto-alojado en un VPS Hetzner: $30/mes = $360/año

- Ahorro: $2,040/año (85%)

Y ese es el escenario conservador. Si tu equipo usa la API intensivamente para generación de código, análisis de documentos o workflows automatizados, los ahorros se multiplican dramáticamente. Con auto-alojamiento, 10,000 consultas cuestan lo mismo que 10 consultas: cero costo marginal.

Privacidad: el elefante en la sala de servidores

Aquí es donde el auto-alojamiento ofrece su ventaja más convincente — y no es ni de cerca comparable.

Qué sucede con ChatGPT

Cuando envías un prompt a ChatGPT:

- Tus datos viajan por internet a los servidores de OpenAI (alojados en Microsoft Azure)

- Se procesan, potencialmente se registran y almacenan según las políticas de retención de datos de OpenAI

- La política de privacidad de OpenAI permite el uso de tus datos para mejora del modelo (a menos que te excluyas vía configuración de API o plan Enterprise)

- Estás sujeto a la jurisdicción de EE.UU., independientemente de dónde te encuentres

Para individuos que charlan casualmente, esto está bien. Para empresas que manejan código propietario, documentos legales, datos de pacientes, registros financieros o secretos comerciales, es inaceptable.

Qué sucede con DeepSeek R1 auto-alojado

Tus datos nunca salen de tu máquina. Punto.

- Los prompts se procesan localmente en tu CPU/GPU

- Sin telemetría, sin registro en servidores externos

- Cumplimiento total de RGPD/HIPAA por defecto — los datos permanecen en tu jurisdicción

- Despliegue air-gapped posible para máxima seguridad

- Tú controlas la retención, el cifrado y las políticas de acceso

Para industrias reguladas (salud, finanzas, legal, gobierno), esto no es un lujo. Es un requisito.

Flujo de datos — IA en la nube vs IA auto-alojada

Escenarios de privacidad del mundo real

| Escenario | ChatGPT | DeepSeek R1 auto-alojado |

|---|---|---|

| Revisión de código fuente propietario | ⚠️ Código enviado a servidores de OpenAI | ✅ Se queda en tu máquina |

| Análisis de registros médicos de pacientes | ❌ Riesgo de cumplimiento HIPAA | ✅ Totalmente conforme localmente |

| Resumen de escritos legales confidenciales | ⚠️ Potencial exposición de datos | ✅ Aislable de la red |

| Procesamiento de datos personales de clientes | ⚠️ Procesador de datos de terceros | ✅ Eres el único procesador |

| Trabajo en proyectos clasificados | ❌ No es posible | ✅ Funciona sin conexión |

Rendimiento: ¿cómo se comparan realmente?

Seamos honestos sobre lo que obtienes con cada opción.

Dónde gana ChatGPT (GPT-4o / o1)

- ✅Capacidades multimodales: comprensión de imágenes, generación DALL-E, modo de voz

- ✅Navegación y plugins: acceso web en tiempo real, ejecución de código

- ✅Ventanas de contexto más amplias: hasta 128K tokens con GPT-4o

- ✅Razonamiento de vanguardia: o1 y o1-pro para problemas complejos de múltiples pasos

- ✅Cero configuración: funciona inmediatamente desde cualquier navegador

Dónde gana DeepSeek R1

- ✅Sin límites de tasa: genera tanto texto como tu hardware permita

- ✅Latencia consistente: sin cola, sin mensajes de "estamos experimentando alta demanda"

- ✅Personalización: fine-tuning en tus datos de dominio para rendimiento especializado superior

- ✅Procesamiento por lotes: procesa miles de documentos durante la noche sin costos de API

- ✅Reproducibilidad: mismo modelo, mismos pesos, salidas deterministas

Puntuaciones de benchmarks — DeepSeek R1 vs GPT-4o vs o1-mini

Comparación de benchmarks (resultados publicados 2025)

| Benchmark | DeepSeek R1 (671B) | GPT-4o | o1-mini |

|---|---|---|---|

| MATH-500 | 97.3% | 74.6% | 90.0% |

| AIME 2024 | 79.8% | 9.3% | 63.6% |

| Codeforces Elo | 2,029 | 759 | 1,820 |

| GPQA Diamond | 71.5% | 49.9% | 60.0% |

| MMLU | 90.8% | 88.7% | 85.2% |

| SWE-bench Verified | 49.2% | 38.4% | 41.6% |

Advertencia importante: estos son benchmarks para el modelo completo de 671B. Si ejecutas una variante destilada de 7B o 14B en hardware modesto, espera puntuaciones más bajas. El destilado 70B retiene la mayor parte de la capacidad de razonamiento y es el punto ideal para auto-alojamiento.

Guía de configuración rápida: DeepSeek R1 + Ollama + Open WebUI

Así es como pasar de cero a tu propio asistente de IA en menos de 10 minutos.

Arquitectura del stack de IA auto-alojado

Paso 1: Instalar Ollama

# macOS / Linux

curl -fsSL https://ollama.com/install.sh | sh

# O en macOS vía Homebrew

brew install ollamaPaso 2: Descargar un modelo DeepSeek R1

Elige tu modelo según tu hardware:

# Ligero (4GB RAM mínimo) — bueno para pruebas

ollama pull deepseek-r1:8b

# Rango medio (16GB RAM) — uso diario sólido

ollama pull deepseek-r1:14b

# Usuario avanzado (32-64GB RAM) — capacidad de razonamiento casi completa

ollama pull deepseek-r1:32b

# Modo bestia (64GB+ RAM o multi-GPU) — calidad máxima

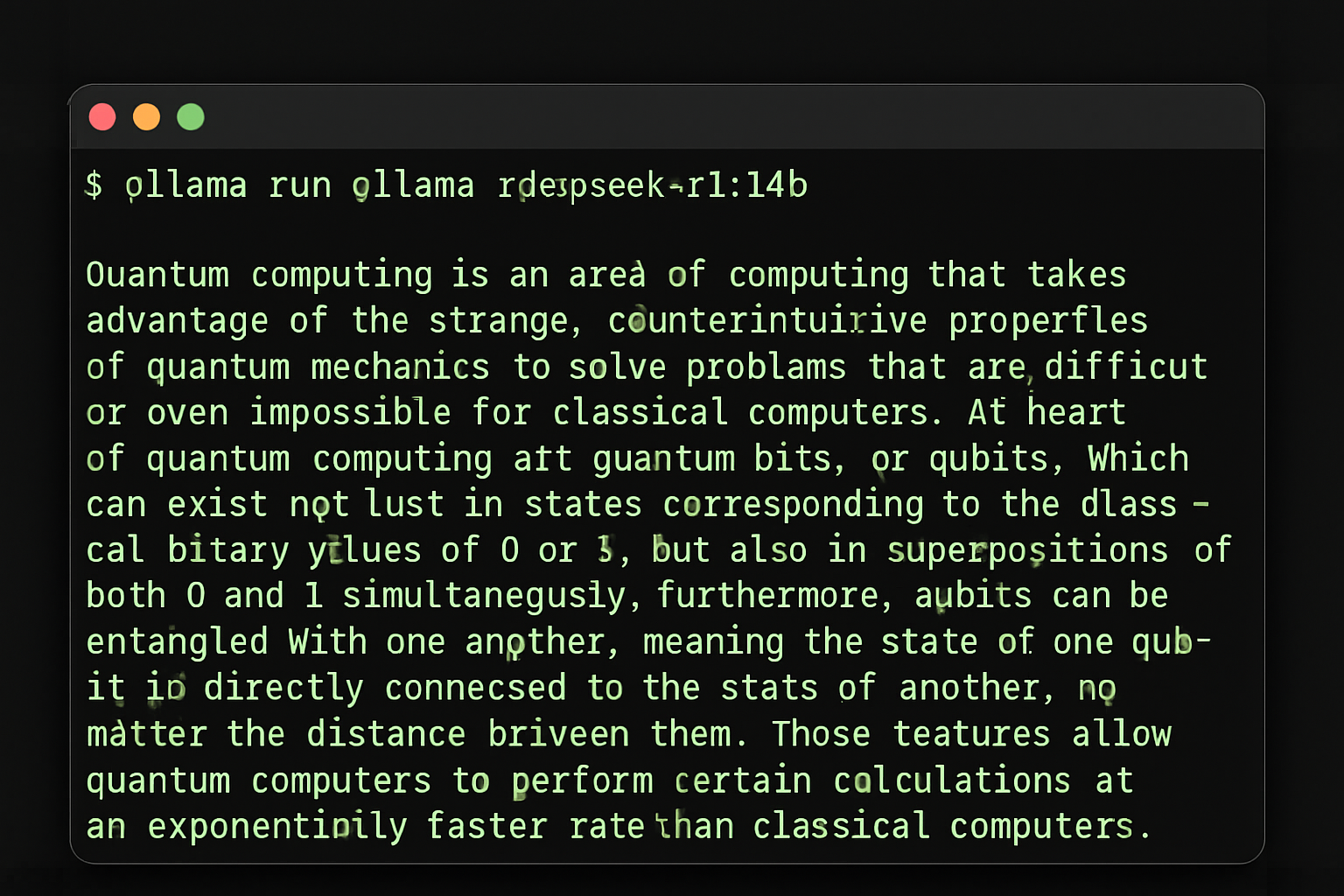

ollama pull deepseek-r1:70bPaso 3: Probarlo en la terminal

ollama run deepseek-r1:14b

Ollama ejecutando DeepSeek R1 — un solo comando para empezar

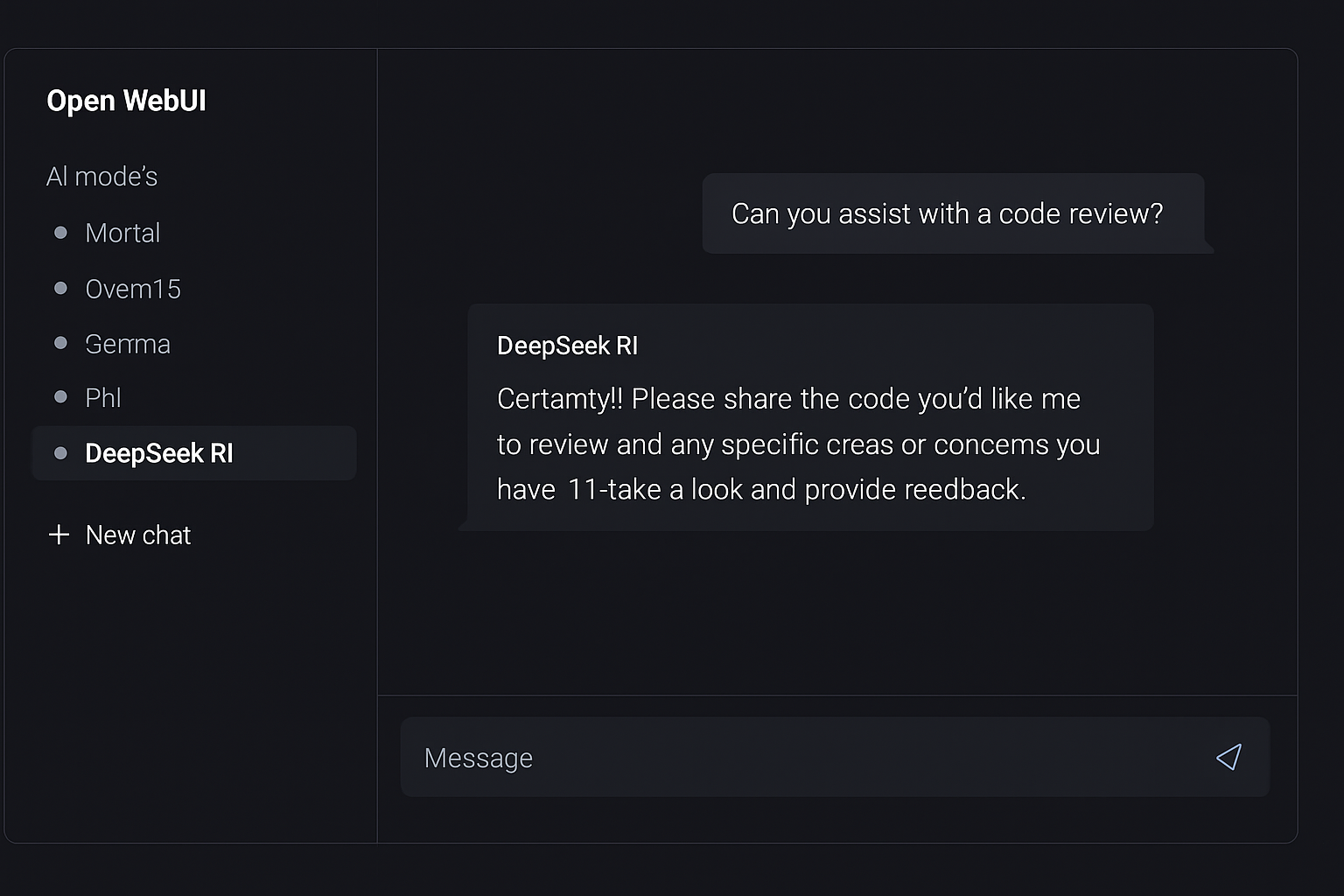

Paso 4: Agregar Open WebUI para una interfaz tipo ChatGPT

# Usando Docker (recomendado)

docker run -d \

--name open-webui \

-p 3000:8080 \

-v open-webui:/app/backend/data \

--add-host=host.docker.internal:host-gateway \

-e OLLAMA_BASE_URL=http://host.docker.internal:11434 \

--restart always \

ghcr.io/open-webui/open-webui:main

Open WebUI — una interfaz tipo ChatGPT para tu IA local

Ahora abre http://localhost:3000 en tu navegador. Crea una cuenta (es local — el primer usuario se convierte en admin), selecciona tu modelo DeepSeek R1 y comienza a chatear.

Paso 5: Exponer a tu equipo (opcional)

server {

listen 443 ssl;

server_name ai.tuempresa.com;

ssl_certificate /ruta/a/cert.pem;

ssl_certificate_key /ruta/a/key.pem;

location / {

proxy_pass http://localhost:3000;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header Upgrade $http_upgrade;

proxy_set_header Connection "upgrade";

}

}Tu equipo ahora tiene un asistente de IA privado y auto-alojado con una interfaz web pulida. Tiempo total de configuración: ~10 minutos.

Casos de uso: cuándo elegir qué

Elige ChatGPT cuando:

- 🔵Necesitas IA multimodal (análisis de imágenes, voz, DALL-E)

- 🔵Quieres cero mantenimiento y acceso instantáneo

- 🔵Eres usuario individual con uso moderado (~$20/mes está bien)

- 🔵Necesitas navegación web en tiempo real integrada en las respuestas

- 🔵Necesitas el último modelo (OpenAI lanza actualizaciones semanalmente)

Elige DeepSeek R1 auto-alojado cuando:

- 🟢La privacidad de datos no es negociable (industrias reguladas, código propietario)

- 🟢Tienes un equipo de 3+ (los costos escalan de manera plana, no por usuario)

- 🟢Procesas altos volúmenes (análisis por lotes, pipelines automatizados)

- 🟢Necesitas capacidad sin conexión (entornos aislados, viajes)

- 🟢Quieres hacer fine-tuning del modelo con tus datos de dominio

- 🟢Estás construyendo IA en tu producto (sin dependencia de API)

- 🟢Quieres costos predecibles (sin facturas sorpresa)

El enfoque híbrido

Muchos equipos en 2026 ejecutan ambos: DeepSeek R1 localmente para asistencia diaria de codificación, revisión de documentos y procesamiento por lotes — mientras mantienen una suscripción ChatGPT Pro para tareas multimodales ocasionales y acceso a modelos de última generación. Esto te da lo mejor de ambos mundos mientras minimiza los costos cloud.

El panorama general: por qué importa el auto-alojamiento de IA

La tendencia hacia la IA auto-alojada no es solo cuestión de ahorrar dinero. Es cuestión de soberanía.

Cuando dependes de un proveedor de IA en la nube, estás sujeto a:

- Cambios de precios — OpenAI ha subido precios antes, y lo hará de nuevo

- Cambios de políticas — Los términos de servicio pueden cambiar de la noche a la mañana

- Decisiones de censura — Lo que el modelo discutirá y lo que no

- Disponibilidad — Las interrupciones suceden, los límites de tasa se ajustan

- Riesgo geopolítico — El acceso puede restringirse por región

Con modelos auto-alojados, eres dueño de tu stack de IA. Tú eliges qué modelo ejecutar, cómo se comporta, qué datos ve y cuándo actualizar. Eso no es solo una ventaja técnica — es una ventaja estratégica.

Conclusión: la jugada inteligente en 2026

Hace un año, auto-alojar IA era un experimento para entusiastas. Hoy, es una estrategia lista para producción utilizada por startups, empresas y desarrolladores independientes en todo el mundo.

DeepSeek R1 ofrece capacidades de razonamiento que compiten con — y en algunos benchmarks superan a — ChatGPT. Ollama hace que el despliegue sea trivial. Open WebUI te da una interfaz pulida. Y mantienes cada byte de datos bajo tu control.

La matemática es simple:

- Equipo de 10 personas en ChatGPT Plus: $2,400/año

- Equipo de 10 personas en DeepSeek R1 auto-alojado: $360/año

- Ahorro anual: $2,040 — y soberanía total de datos

ChatGPT sigue siendo un excelente producto. Pero cuando puedes igualar sus capacidades principales a una fracción del costo mientras mantienes tus datos privados, la jugada inteligente es clara.

¿Listo para explorar más herramientas de IA auto-alojadas? Explora nuestro directorio curado de aplicaciones auto-alojables en hostly.sh — desde asistentes de IA hasta plataformas de automatización, te ayudamos a encontrar el mejor software de código abierto para ejecutar en tu propia infraestructura.

¿Encontraste útil esta comparación? Consulta nuestras otras guías sobre alternativas auto-alojadas a herramientas SaaS populares.